L'IA locale : promesse réaliste ou simple alternative au cloud ?

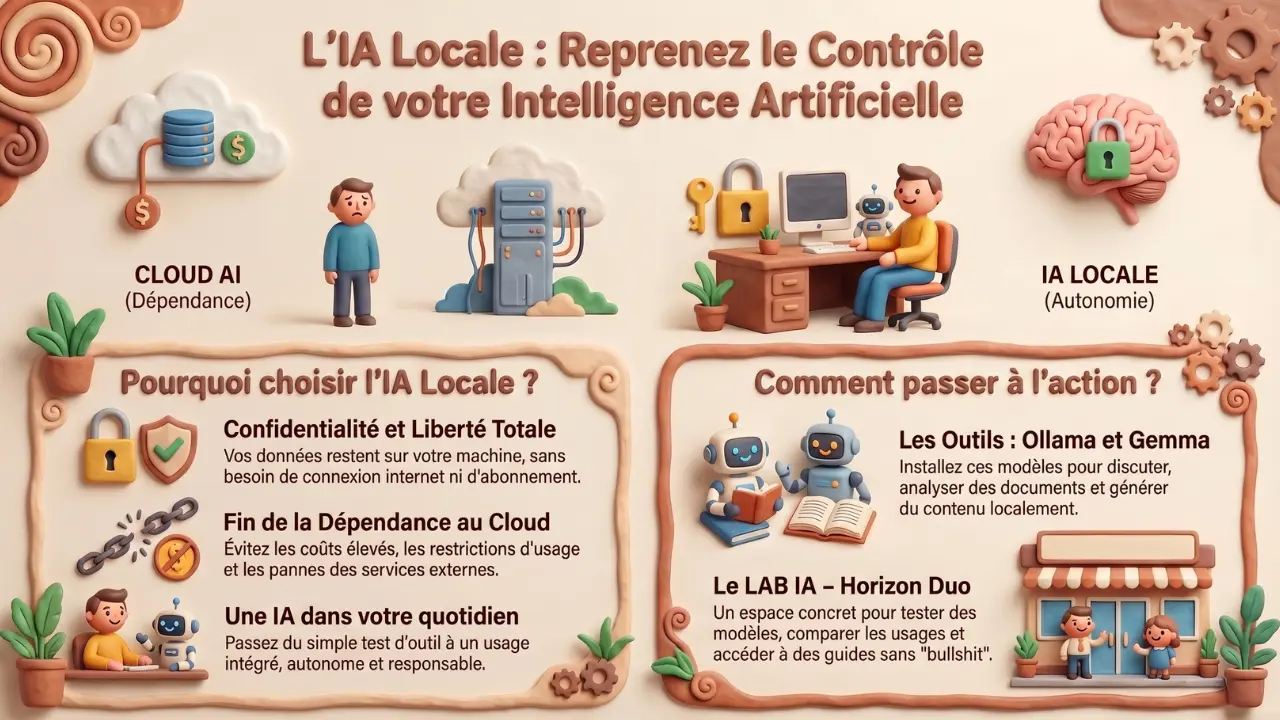

Face aux limites des IA cloud (coûts, dépendance, restrictions), une alternative émerge : l'IA locale. Mais que permet-elle réellement aujourd'hui ? Et à quelles conditions ?

Une promesse séduisante… mais encadrée

L'IA autonome, capable de travailler seule et d'enchaîner des tâches complexes, est aujourd'hui omniprésente dans les discours.

Dans la pratique, l'expérience est souvent différente :

- Multiplication des abonnements

- Limitations d'usage imprévisibles

- Dépendance forte à des plateformes externes

Et surtout : dès que la connexion disparaît… l'outil devient inutilisable.

L'IA locale : une approche différente

Une alternative consiste à faire tourner des modèles directement sur sa machine, sans passer par le cloud.

Des outils comme Ollama permettent aujourd'hui de lancer des modèles open source, comme Gemma, en local.

Le principe est simple :

- Le modèle est téléchargé sur votre ordinateur

- Les requêtes sont traitées en local

- Aucune donnée n'est envoyée vers un serveur externe

On passe d'un usage "service en ligne" à un véritable outil personnel.

Des performances… qui dépendent du matériel

Contrairement aux solutions cloud, les performances en local ne sont pas uniformes.

Elles dépendent directement de votre machine :

- RAM disponible (idéalement 16 Go minimum)

- Puissance CPU / GPU

- Stockage rapide (SSD recommandé)

Sur un MacBook Air M2 avec 16 Go de RAM, par exemple, un modèle comme Gemma 4 (version légère) fonctionne correctement pour :

- Génération de texte

- Analyse de documents

- Tests de prompts

Les temps de réponse restent cependant plus longs qu'en cloud.

Adapter le modèle à l'usage

Un point souvent sous-estimé : tous les modèles ne sont pas adaptés à tous les usages.

Dans certains cas, utiliser un modèle plus ancien ou plus léger peut être plus efficace :

- Réponses plus rapides

- Consommation mémoire réduite

- Meilleure stabilité

L'objectif n'est pas d'avoir "le modèle le plus puissant", mais le modèle le plus adapté à la tâche.

Stockage : un point clé souvent oublié

Les modèles d'IA peuvent être volumineux (plusieurs gigaoctets).

Une solution simple consiste à :

- Stocker les modèles sur un disque SSD externe

- Garder uniquement les modèles actifs en local

Cela permet de conserver de la flexibilité sans saturer son ordinateur.

Une expérience encore technique

Aujourd'hui, l'IA locale reste moins accessible que les outils cloud.

L'utilisation passe souvent par le terminal :

- Installation via commandes

- Lancement des modèles en ligne de commande

- Peu d'interface utilisateur

Une approche efficace, mais peu intuitive pour le grand public.

Vers une démocratisation des usages

Cette situation est en train d'évoluer.

Des interfaces plus accessibles apparaissent progressivement.

De notre côté, une application est en cours de développement pour :

- Sélectionner facilement un modèle

- Échanger via une interface simple (type ChatGPT)

- Centraliser les usages locaux

Objectif : rendre l'IA locale accessible sans passer par le terminal.

Le LAB IA : tester plutôt que promettre

Le LAB IA regroupe :

- Des vidéos de test

- Des guides pratiques (dont un PDF pour démarrer)

- Des expérimentations en conditions réelles

Conclusion

L'IA locale n'est pas une solution miracle.

Mais elle offre une alternative crédible à certaines limites du cloud.

Moins spectaculaire. Plus technique. Mais souvent plus maîtrisable.

Moins de promesses. Plus de réalité.

Pour aller plus loin

Si tu veux mieux comprendre le contexte autour des agents IA et des approches "autonomes" (type OpenClaw), voici quelques ressources complémentaires :

- Agent IA : quand l'intelligence artificielle apprend et crée ses propres outils

- Agent IA : l'IA qui travaille pendant que vous dormez (OpenClaw – épisode 2)

- OpenClaw : l'agent IA qui transforme le chatbot en assistant autonome

Ces approches reposent fortement sur le cloud et des infrastructures complexes. L'IA locale propose justement une autre voie, plus simple, plus maîtrisable… mais avec ses propres limites.